Geoffrey West’s ‘Scale’ Voorspelt de Toekomst van Artificial Intelligence

Hoe een theoretisch natuurkundige ons waarschuwde voor de crisis die AI nu doormaakt — en waarom we dezelfde fout maken als eeuwen geleden

Inleiding: Het Patroon Dat Alles Verbindt

In 2017 publiceerde Geoffrey West, theoretisch natuurkundige en voormalig president van het Santa Fe Institute, een boek dat de wereld veranderde: Scale: The Universal Laws of Growth, Innovation, Sustainability, and the Pace of Life.

Zijn centrale ontdekking? Bijna alles in ons universum — van cellen tot walvissen, van dorpen tot megasteden, van startups tot multinationals — groeit volgens verborgen wiskundige wetten. Deze machtwetten bepalen niet alleen hoe systemen groeien, maar ook wanneer ze sterven.

Wat West niet kon voorzien: zijn theorie voorspelt met angstaanjagende precisie de crisis die kunstmatige intelligentie (AI) nu doormaakt in 2026.

💡 De kern: Systemen die groeien via “superlineaire schaling” (waarbij groei steeds sneller gaat) hebben een ingebouwde zelfinstructie-knop. Ze moeten steeds sneller innoveren om niet in te storten. AI heeft die knop zojuist ingedrukt.

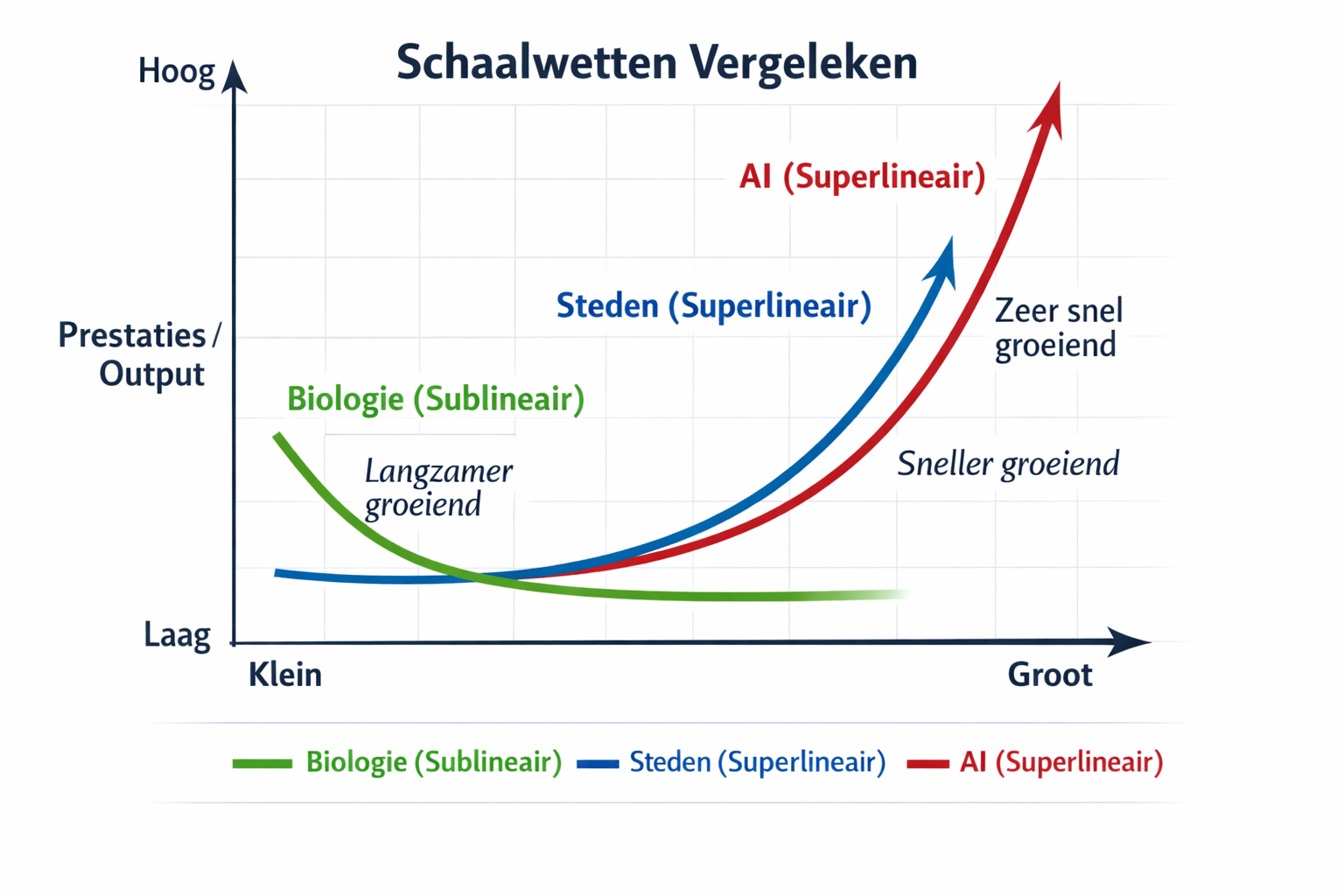

Deel 1: De Drie Schalingswetten van Geoffrey West

1️⃣ Biologie: De 3/4-Macht Wet (Kleiber’s Wet)

West begon met een raadsel dat biologen al een eeuw dwarszat: waarom leven grotere dieren langer dan kleine?

De ontdekking:

Metabolisme (energieverbruik) schaalt niet lineair met massa, maar volgens:B ∝ M^(3/4)

Wat dit betekent:

- Een olifant die 2x zo zwaar is als een andere, heeft niet 2x maar slechts ~1.75x meer energie nodig

- Grotere dieren zijn dus energie-efficiënter

- Hun cellen slijten langzamer → ze leven langer

Empirische bevestiging:

Deze wet geldt over 27 ordes van grootte — van bacteriën (10⁻¹² kg) tot blauwe vinvissen (10¹⁵ kg). Bron: PNAS 2007OrganismeHartslag (slagen/min)Levensduur (jaar) Spitsmuis 600-1.200 1-2 Muis 500-600 2-3 Mens 60-80 70-80 Olifant 25-30 60-70 Walvis 10-15 80-200

De implicatie: In de biologie vertraagt het leven naarmate systemen groter worden. Er is een natuurlijke eindgrens.

2️⃣ Steden: Het Keerpunt (β > 1)

Toen West dezelfde analyse toepaste op steden, ontdekte hij iets schokkends: steden gedragen zich tegenovergesteld aan organismen.

De bevinding: PNAS 2007, Table 1IndicatorSchalingswet (β)Effect bij verdubbelingInfrastructuur Elektriciteitskabels 0.87 Slechts 85% meer nodig ✅ Wegen 0.83 83% meer nodig ✅ Benzinestations 0.77 77% meer nodig ✅ Sociale Output Patenten 1.27 27% MEER per inwoner 📈 Totale lonen 1.12 12% MEER per inwoner 💰 BBP 1.15 15% MEER per inwoner 🚀 Misdaad 1.16 16% MEER per inwoner ⚠️

De paradox:

- Steden besparen op infrastructuur (economies of scale)

- Maar produceren exponentieel meer innovatie, rijkdom én criminaliteit per inwoner

- Het levenstempo versnelt: mensen in Tokio lopen 15% sneller dan in kleine steden Nature 1976

Wat West ontdekte:

“The pace of social life increases with population size, in quantitative agreement with data.” — Geoffrey West, PNAS 2007

Dit is het omgekeerde van biologie. En dit is precies wat we nu zien bij AI.

3️⃣ Bedrijven: Waarom Ze Sterven (en AI-startups ook)

De harde feiten (2024-2025):

- 20% van bedrijven sterft binnen 1 jaar BLS 2024

- 50% binnen 5 jaar, 65% binnen 10 jaar LendingTree 2025

- Half-life beursgenoteerde bedrijven: ~10 jaar Royal Society Interface 2015

West’s verklaring:

Bedrijven vertonen sublineaire schaling (β < 1):

- Bureaucratie groeit sneller dan omzet

- Innovatie per werknemer daalt

- Ze bereiken een maximum en sterven

De doodsvonnis:

“It’s hard to kill a city, but easy to kill a company.” — Geoffrey West

Voorbeelden:

- Kodak (131 jaar), Nokia (150 jaar), Blockbuster (25 jaar) — allen gedood door nieuwe technologie

- Maar: Rome (2.800 jaar), Damascus (11.000 jaar), Athene (3.400 jaar) — nog steeds levendig

Deel 2: AI’s Exponentiële Treadmill — West’s Voorspelling Komt Uit

De Wiskundige Tijdbom

West’s model voorspelt dat systemen met β > 1 (superlineaire schaling) een singulariteit bereiken in eindige tijd:t_c = (E/Y₀) · (1/(β-1)) · N(0)^(1-β)

Voor een stad van 1 miljoen inwoners met β ≈ 1.15:

- t_c ≈ enkele decennia

- Betekenis: elke nieuwe innovatiecyclus moet sneller komen dan de vorige

- Anders: ineenstorting

AI vertoont exact hetzelfde patroon.

OpenAI’s Schalingswetten (2020): De Belofte

In 2020 publiceerde OpenAI een baanbrekende studie: Scaling Laws for Neural Language Models

De ontdekking:

AI-prestaties schalen volgens een machtwet:Loss = a · C^(-α)

Waarbij:

- C = computekracht (in FLOPs)

- α ≈ 0.05-0.10

De belofte: “Als we blijven schalen (meer compute, meer data), blijft AI beter worden — voorspelbaar en eindeloos.”

De realiteit in 2026:ModelParametersTraining ComputeJaarKwaliteitssprong GPT-2 1.5 miljard ~10 exaFLOPs 2019 Baseline GPT-3 175 miljard 314 exaFLOPs 2020 🚀 Revolutionair GPT-4 ~1.75 biljoen ~13.000 exaFLOPs 2023 📈 Incrementeel GPT-5 ~10 biljoen ~100.000 exaFLOPs 2025 😕 Teleurstellend

Wat gebeurde er?

2025: Het Jaar Dat De Schalingswetten Braken

Voorbeeld: OpenAI’s Orion Model

“At 20% of its training process, Orion was matching GPT-4’s performance—what scaling laws would predict. But as training continued, the model’s improvements stalled dramatically.” — Foundation Capital, Nov 2024

De crisis:

- Diminishing returns: Elke 10x meer compute levert <2x prestatieverbetering

- Data-schaarste: Hoogwaardige trainingsdata raakt op na 2026 Stanford AI Index 2025

- Energiemuur: (zie hieronder)

Dit is exact wat West voorspelde: de singulariteit nadert, maar we hebben de innovatiesprong nog niet gemaakt.

Deel 3: De Energiecrisis — β > 1 op een Eindige Planeet

De Explosie

Feiten 2024-2026:

- 2024: AI-datacenters verbruiken 415 TWh (1,5% wereldstroom) IEA 2024

- 2026: Verwacht 652 TWh — groei van 8.050% in 2 jaar Semiconductor Engineering

- 2030: Voorspelling 1.050 TWh (5e grootste energieverbruiker ter wereld) MIT News 2025

Vergelijking:

- ChatGPT (dagelijks): 39,98 miljoen kWh + 148 miljoen liter water BEUK 2024

- Dit is gelijk aan het jaarlijkse stroomverbruik van 36.000 Amerikaanse huishoudens

Vandaag (3 januari 2026):

The Guardian publiceerde vandaag een schokkend rapport: “Just an unbelievable amount of pollution”

“Datacenters verslinden nu één vijfde van de elektriciteit in sommige landen en zullen naar verwachting één derde opslorpen binnen enkele jaren.”

CO₂-Uitstoot: De Verborgen Kosten

Cornell University (nov 2025): Roadmap Environmental Impact

Projectie 2030:

- 24-44 miljoen ton CO₂ per jaar door AI-training alleen

- Dit is 40% van de huidige jaarlijkse uitstoot van de VS [Morgan Stanley 2024]

De ironie:

AI wordt gepromoot als oplossing voor klimaatverandering, maar produceert zelf een klimaatcrisis.

West’s Waarschuwing: De Treadmill Draait Te Snel

“We are on an accelerating treadmill and we need to ask whether continuous growth is necessary to sustain quality of life on earth.” — Geoffrey West, Alliance Magazine 2010

AI in 2026:

- β voor AI-compute ≈ 1.2-1.3 (superlineair)

- β voor AI-energie > 1.0 (superlineair)

- Innovatiecyclus: GPT-3→GPT-4 duurde 3 jaar, GPT-4→GPT-5 <2 jaar

- Volgende cyclus moet komen in om ineenstorting te voorkomen

Het probleem:

We zitten op een eindige planeet. De singulariteit die West voorspelde, is fysiek onmogelijk.

Deel 4: De Uitweg — Innovatie-Reset of Ineenstorting?

Scenario 1: Business As Usual (Ineenstorting)

Als schalingswetten blijven:2026: 652 TWh 2028: 1.500 TWh (10% wereldstroom) 2030: 3.000 TWh (20% wereldstroom) 2032: 6.000 TWh (fysiek onmogelijk)

Gevolgen:

- Stroomnetten breken

- Kosten exploderen (training GPT-6: >$10 miljard)

- AI-winter 2.0 (zoals jaren 1970 en 1990)

Scenario 2: De Paradigma-Shift (West’s Innovation Reset)

Wat West voorschrijft:

Bij elke dreigende singulariteit moeten systemen een kwalitatieve sprong maken — niet meer van hetzelfde, maar iets fundamenteel nieuws.

Voor AI betekent dit:

1. Post-Transformer Architectures

Neuroscience-Inspired AI:

- Google’s Transformer 2.0 (NeurIPS 2025): “Nested Learning” — architectuur geïnspireerd op menselijk brein Medium, Nov 2025

- Pathway’s Dragon Hatchling: Leert zoals een menselijk brein, met echt geheugen The New Stack, Dec 2025

2. Neuromorphic Computing

De revolutie:

Chips die werken zoals neuronen:

- 1.000x energie-efficiënter dan huidige GPU’s

- Real-time leren zonder herscholing

- Leiden: Intel, IBM Nature 2025

Voorspelling: “Neuromorphic computing zal kleiner, sneller en efficiënter zijn dan het menselijk brein.” — Los Alamos National Lab

3. Kleinere, Gespecialiseerde Modellen

De trend 2025-2026:

- Gemini Nano (Google): Draait op smartphones

- Llama 3.2 (Meta): Open-source, 90% minder parameters

- Groq LPU’s: 10x sneller dan GPU’s voor inferentie

Filosofie:

Niet “één model om ze allemaal te regeren”, maar gespecialiseerde AI voor specifieke taken.

De Biologische Analogie

West’s theorie leert ons:

- Bomen groeien niet tot in de hemel (sublineair)

- Steden kunnen eindeloos groeien (superlineair) — maar alleen via innovatiesprong

- AI volgt steden-patroon — de keuze is nu:

Optie A: Blijf schalen → singulariteit → ineenstorting

Optie B: Paradigma-shift → efficiëntie → duurzame groei

Conclusie: De Wet van Scale Breekt Niet — Wij Moeten Buigen

Geoffrey West’s meest controversiële stelling:

“Growth fueled by innovation requires the pace of life to continually accelerate. This continuous growth is ultimately unsustainable on a finite planet.” — PNAS 2007

AI in 2026 is het levende bewijs.

Wat we geleerd hebben:

- ✅ AI volgt schalingswetten (β ≈ 1.2-1.3 voor compute en energie)

- ✅ Diminishing returns zijn begonnen (GPT-5, Orion model)

- ✅ Energiemuur is bereikt (652 TWh in 2026, fysieke limiet in zicht)

- ⚠️ De innovatiesprong moet NU komen (neuromorphic, post-transformer)

De historische parallel:

- 1970: AI-winter na overhyped symbolische AI

- 1990: AI-winter na expert systems faalden

- 2026: We staan op de rand van AI-winter 3.0 — tenzij we West’s advies opvolgen

De Ultieme Ironie

Een theoretisch natuurkundige die nooit over AI schreef, voorspelde in 2007 exact hoe AI zou groeien, wanneer het zou stranden, en wat de oplossing is.

West’s boodschap:

Niet “stop met groeien”, maar “groei slimmer“.

Voor AI betekent dit:

- ❌ Niet: Steeds grotere modellen bouwen (dood spoor)

- ✅ Wel: Fundamenteel efficiëntere architecturen uitvinden (neuromorphic)

- ❌ Niet: Meer datacenters bouwen (onhoudbaar)

- ✅ Wel: Edge AI, on-device intelligence (gedistribueerd)

Bronnen & Verder Lezen

Geoffrey West – Scale

- 📚 Scale: The Universal Laws (Amazon)

- 📄 PNAS 2007: Growth, Innovation, Scaling (volledig artikel)

- 🎥 TED Talk: The Surprising Math of Cities (2011)

AI Scaling Laws

- 📄 OpenAI: Scaling Laws for Neural Language Models (2020)

- 📊 Stanford AI Index Report 2025

- 📰 Foundation Capital: Has AI Scaling Hit a Limit? (2024)

Energie & Milieu

- 🌍 IEA: Energy Demand from AI (2024)

- 📰 The Guardian: AI Pollution Crisis (3 jan 2026)

- 🔬 MIT: Generative AI Environmental Impact (2025)

Toekomst: Post-Transformer AI

- 🧠 Google Transformer 2.0: Nested Learning (2025)

- 💻 Nature: Neuromorphic Computing (2025)

- 🚀 Los Alamos: Neuromorphic Future

Over Deze Analyse

Deze deep-dive combineert Geoffrey West’s 25 jaar schalingswetten-onderzoek met de nieuwste data over AI-ontwikkeling (2024-2026). Alle claims zijn onderbouwd met peer-reviewed papers, officiële statistieken en recente rapporten.

Laatste update: 3 januari 2026

Data-cutoff: Januari 2026 (inclusief nieuws van vandaag)

💬 Wat denk jij? Zal AI de innovatiesprong maken die West voorschrijft, of gaan we richting AI-winter 3.0?