De Kracht van Residual Connections en Extreme Efficiëntie

DeepSeek heeft eind 2024 en begin 2025 de AI-wereld op zijn kop gezet met modellen die de prestaties van GPT-4 evenaren, maar tegen een fractie van de kosten. Maar wat maakt deze Chinese AI-startup nu precies zo bijzonder? Het antwoord ligt in een combinatie van slimme architectuurkeuzes, extreme efficiëntie en baanbrekende optimalisaties.

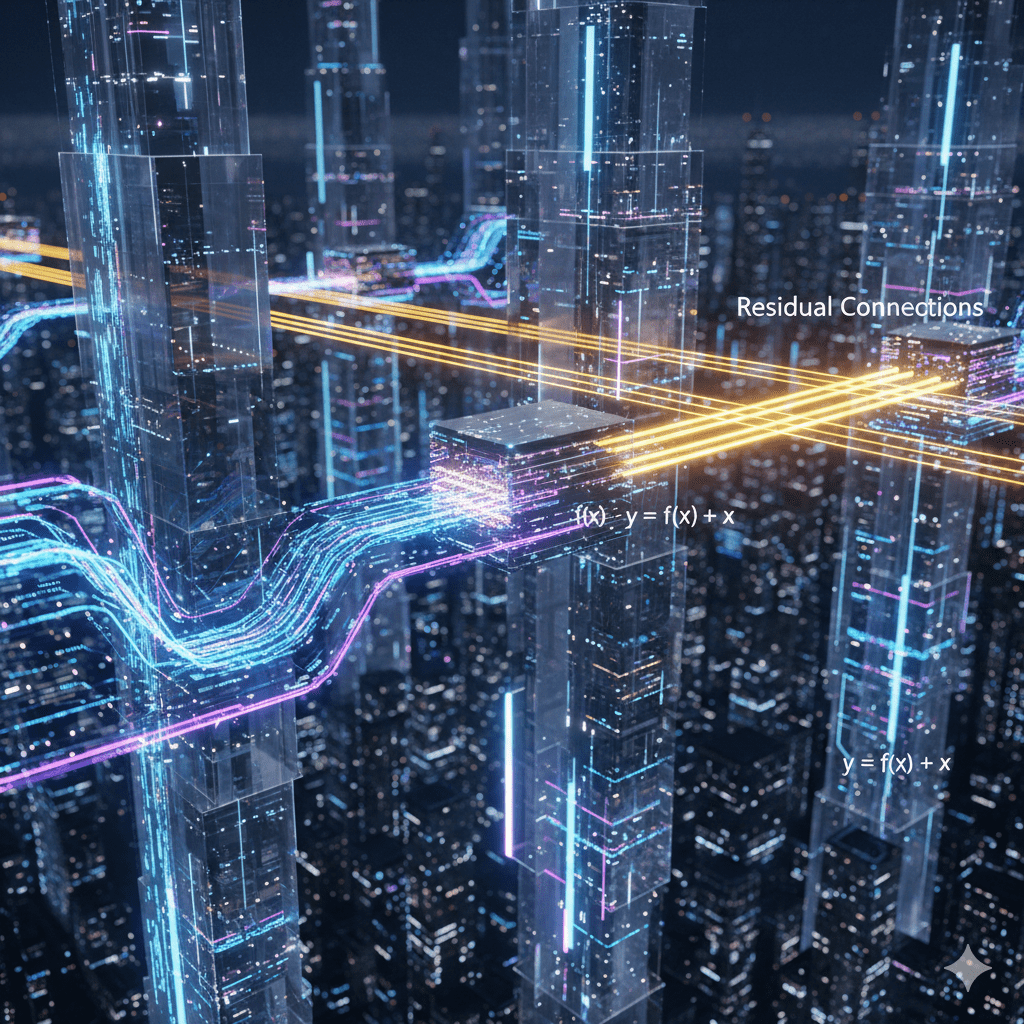

Wat zijn Residual Connections?

Voordat we ingaan op DeepSeek’s innovaties, moeten we eerst begrijpen wat residual connections zijn en waarom ze zo belangrijk zijn voor moderne AI.

Het Vanishing Gradient Probleem

In traditionele “diepe” neurale netwerken gaat data laag na laag door het systeem. Het probleem? Naarmate je meer lagen toevoegt (bijvoorbeeld 100+), doven de leersignalen (de zogenaamde “gradiënten”) langzaam uit of exploderen juist. Dit heet het vanishing gradient probleem.

De ResNet-Revolutie (2015)

Microsoft Research loste dit in 2015 op met de introductie van ResNet (Residual Network) en residual connections. Het basisidee is elegant simpel: in plaats van dat elke laag de input volledig moet transformeren, leert de laag alleen het verschil (het residu) dat moet worden toegevoegd aan de originele input.

De formule: y = f(x) + x

Hierbij is x de input, f(x) de berekening van de laag, en y de output.

Het voordeel: Via de “+ x” route kan data ongehinderd door het hele netwerk stromen. Als een laag “niets” leert, geeft hij de input gewoon onveranderd door. Dit maakt het mogelijk om netwerken te bouwen met honderden of zelfs duizenden lagen zonder dat ze onbestuurbaar worden Microsoft Research.

Waarom is DeepSeek Nu Zoveel Efficiënter?

Vrijwel alle moderne AI-modellen (inclusief GPT-4) gebruiken residual connections. DeepSeek’s doorbraak komt niet alleen van deze basistechniek, maar van hoe ze de architectuur hebben geoptimaliseerd voor extreme efficiëntie en prestaties.

1. Multi-head Latent Attention (MLA)

DeepSeek heeft een revolutionaire manier ontwikkeld om de “aandacht” (attention) van het model veel efficiënter te maken.

Het probleem: Traditionele attention-mechanismen verbruiken enorm veel geheugen (VRAM) om de context van een gesprek te onthouden. Dit wordt opgeslagen in de zogenaamde “KV cache” (key-value cache).

De oplossing: MLA comprimeert deze informatie drastisch door low-rank compressie toe te passen op de key- en value-tensoren. Dit betekent dat DeepSeek veel sneller en goedkoper kan rekenen dan modellen van OpenAI of Google, zonder verlies van kwaliteit Medium – DeepSeek-V3 Explained.

2. DeepSeekMoE (Mixture of Experts)

DeepSeek-V3 heeft 671 miljard parameters in totaal, maar activeert slechts 37 miljard parameters per token. Hoe? Door een zeer verfijnde “Mixture of Experts” (MoE) architectuur arXiv – DeepSeek-V3.

Hoe het werkt:

- In plaats van dat het hele model bij elke vraag geactiveerd wordt, worden alleen de relevante “experts” (kleine gespecialiseerde stukjes van het model) opgeroepen

- DeepSeek gebruikt zeer kleine experts en een paar “vaste” experts die altijd actief zijn om algemene kennis te bewaren

- Dit reduceert het GPU-geheugengebruik met 80% vergeleken met dense modellen Medium – MoE Analysis

Het resultaat: Slechts 5,5% van de totale parameters wordt per query gebruikt, wat leidt tot 4,6x kostenbesparingen ten opzichte van GPT-4o Medium – RAG Analysis.

3. Multi-Token Prediction (MTP)

Een andere slimme innovatie is Multi-Token Prediction. In plaats van slechts één token (woord) per keer te voorspellen, traint DeepSeek het model om meerdere toekomstige tokens tegelijk te voorspellen.

De voordelen:

- Verrijkt de leersignalen tijdens training

- Versterkt de interne representaties van het model

- Kan gebruikt worden voor “speculative decoding” tijdens inferentie, waardoor de snelheid toeneemt arXiv – DeepSeek-V3 Technical Report

4. Manifold-Constrained Hyper-Connections (mHC) – De Nieuwste Doorbraak

Begin januari 2026 publiceerde DeepSeek een baanbrekend onderzoek over het verbeteren van residual connections zelf. Ze noemen dit mHC (Manifold-Constrained Hyper-Connections).

Het probleem met traditionele hyper-connections: Eerdere pogingen om residual connections “slim” te maken (waarbij het netwerk leert hoe de shortcuts te mixen) waren instabiel. Signalen werden tot 3000x versterkt in diepe netwerken, wat leidde tot exploderende gradiënten Reddit – mHC Deep Dive.

De oplossing: DeepSeek stabiliseerde dit door de matrices te projecteren op een “constrained manifold” (beperkt wiskundig oppervlak). Dit maakt het mogelijk om nog diepere en bredere netwerken te bouwen zonder dat de training vastloopt arXiv – mHC Paper.

Extreme Kostenefficiëntie

Misschien wel het meest indrukwekkende aspect van DeepSeek is de kostenefficiëntie:

- Training van DeepSeek-V3: Ongeveer $5-6 miljoen aan compute-kosten

- Training van GPT-4: Geschat op $100-500 miljoen

- Kostenverhouding: DeepSeek is 9x goedkoper in gebruik dan GPT-4o per miljoen tokens Analytics Vidhya

Hoe bereiken ze dit?

- Slimme algorithme-optimalisaties (MLA, MoE, MTP)

- Gebruik van Chinese NVIDIA H800 GPU’s in plaats van duurdere H100/A100 chips

- Efficiënte training: slechts 2,788M H800 GPU-uren voor het volledige trainingsproces

- Geen rollbacks nodig: de training verliep extreem stabiel zonder irrecoverable loss spikes InfoQ

Prestaties: DeepSeek vs GPT-4

DeepSeek-V3 en het redeneermodel DeepSeek-R1 (gebaseerd op V3) behalen indrukwekkende resultaten:

- Wiskundige competities: ~79,8% pass@1 op Amerikaanse wiskundecompetities Fireworks.ai

- Code generatie: 82,6% op HumanEval-Mul (vs 80,5% voor GPT-4) Codefinity

- Programmeer-benchmarks: DeepSeek-V3.1 behaalt 71,6% pass rate in Aider programming tests, beter dan Claude Opus Dev.to

Conclusie

DeepSeek’s succes komt niet van één magische oplossing, maar van een combinatie van slimme architectuurbeslissingen:

- Residual connections als fundament (de snelweg voor data)

- Multi-head Latent Attention voor efficiënte verkeersleiding

- Mixture of Experts voor slimme specialisatie

- Multi-Token Prediction voor snellere training

- Manifold-Constrained Hyper-Connections voor ultradiepe netwerken

Het resultaat? Een AI-model dat presteert als GPT-4, maar tegen minder dan 1/10e van de kosten kan worden getraind en gebruikt. Deze efficiëntie-revolutie laat zien dat state-of-the-art AI niet per se extreem duur hoeft te zijn – als je slim genoeg bent.

Bronnen:

- Microsoft Research – Deep Residual Learning (2015)

- arXiv – DeepSeek-V3 Technical Report

- Fireworks.ai – DeepSeek-R1 Overview

- Analytics Vidhya – DeepSeek V3 vs GPT-4o

- arXiv – mHC: Manifold-Constrained Hyper-Connections